寫在前面:

當今正處在科技迅猛發展的時代,人工智能技術的應用與創新已經滲透到各個領域,并為人類的生活與工作帶來了深遠的影響。“具身智能”是人工智能與物理實體結合的產物,正逐漸成為推動科技發展和產業變革的重要力量。5月17日是世界電信日,科普中國聯合中國移動科學技術協會特別策劃“具身智能”系列內容,為您詳細解讀。

(二) 技術篇

寫在前面:通過前面一章的背景介紹,我們了解了具身智能的相關概念和發展歷程。下面我們將結合論文探討一下相關的技術。

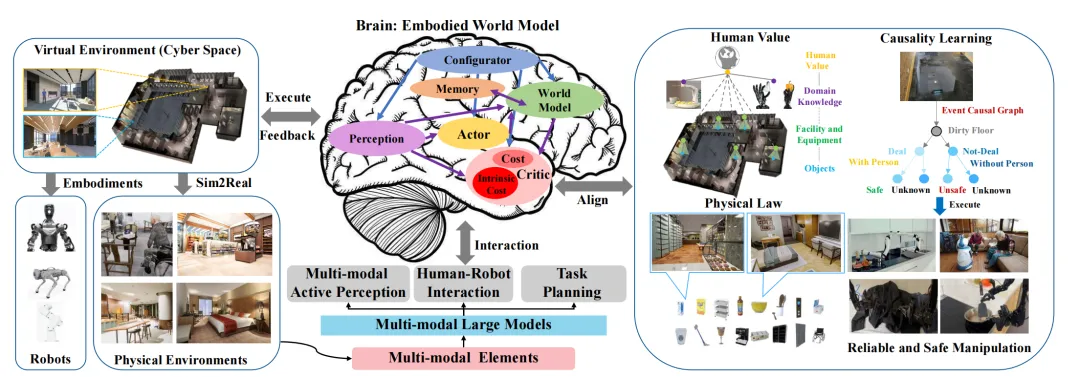

通過前面的相關概念,我們了解到虛擬空間中的智能體可以被稱為離身人工智能,而物理空間中的智能體則是具身人工智能,即具身智能。具身智能是連接虛擬與真實世界的橋梁,其核心在于通過物理實體(如機器人)與環境的主動交互,實現智能的具象化。下面是參考論文[4]給出的參考框架。

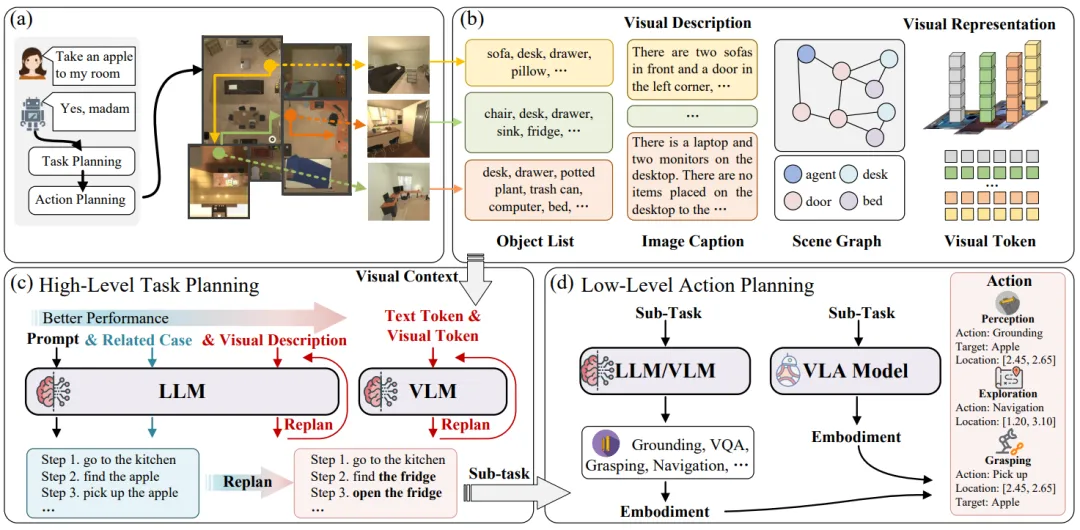

圖4 具身智能體框架[4]

具身智能體必須充分理解語言指令中的人類意圖,主動探索周圍環境,全面感知來自虛擬和物理環境的多模態元素,并針對復雜任務執行恰當的動作。上圖是圍繞身智能體展開的具身智能總體框架,通過整合多種技術和方法,實現了在虛擬和物理環境中的感知、交互和任務執行。下面從具身機器人、具身仿真平臺、具身感知、具身交互、具身智能體、虛擬到現實的遷移幾個方面展開分析。

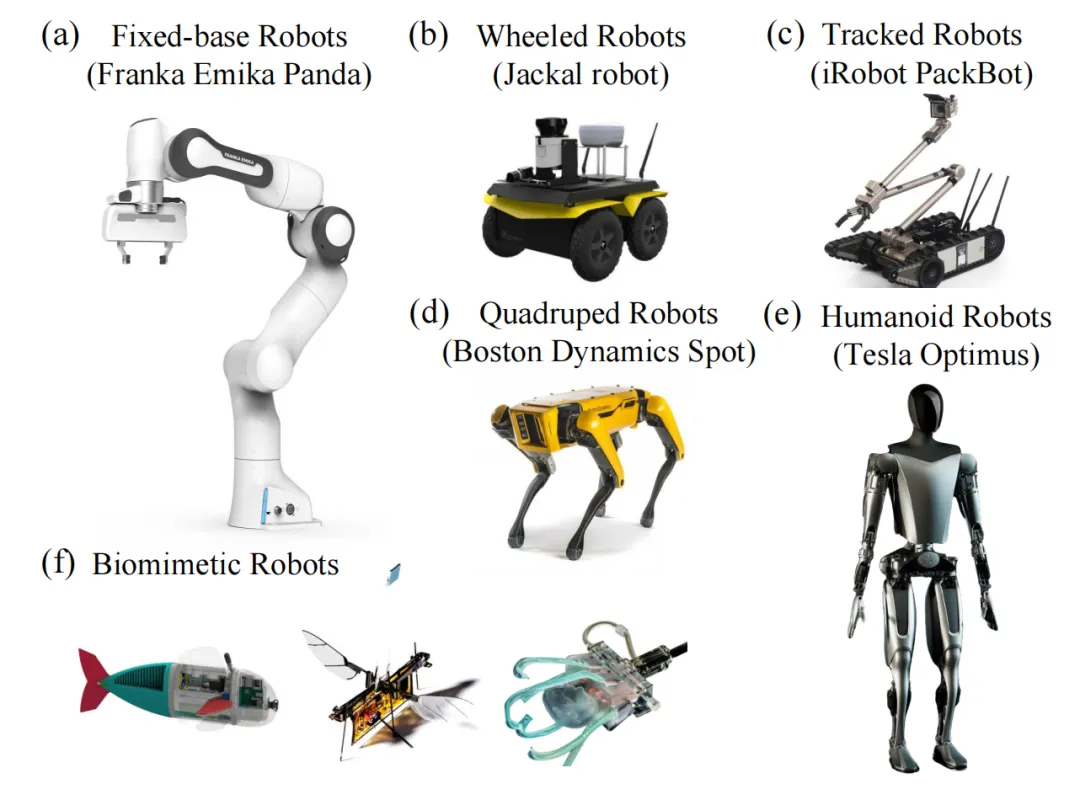

具身機器人

是具身智能在物理世界中的硬件方案。具身智能體積極與物理環境互動,涵蓋了廣泛的具身形態,包括機器人、智能家電、智能眼鏡和自動駕駛車輛等。其中,機器人作為最突出的具身形態之一,備受關注。根據不同的應用場景,機器人被設計成各種形式,以充分利用其硬件特性來完成特定任務。如下圖所示,具身機器人一般可分為:固定基座型機器人,如機械臂,常應用在實驗室自動化合成、教育、工業等領域中;輪式機器人,廣泛應用于物流、倉儲和安全檢查;履帶機器人,具有強大的越野能力和機動性,在農業、建筑和災難場景的應對方面顯示出潛力;四足機器人,以其穩定性和適應性而聞名,非常適合復雜地形的探測、救援任務和軍事應用;人形機器人,以其靈巧手為關鍵,在服務業、醫療保健和協作環境等領域廣泛應用;仿生機器人,通過模擬自然生物的有效運動和功能,在復雜和動態的環境中執行任務。

圖5 具身機器人分類[4]

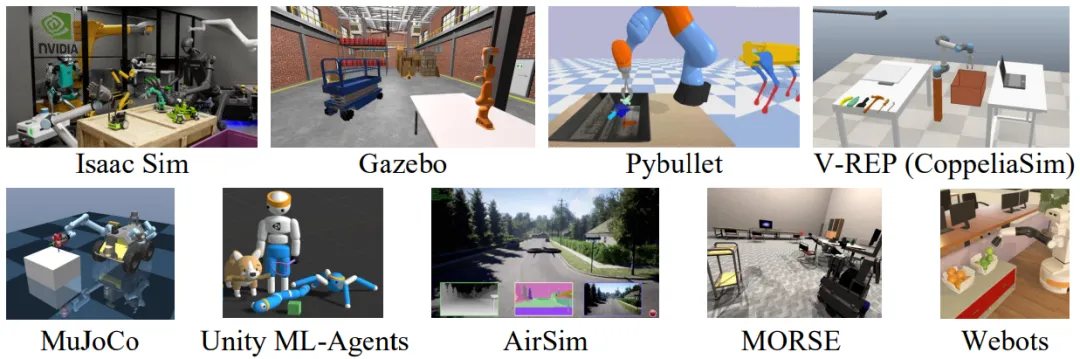

具身智能仿真平臺

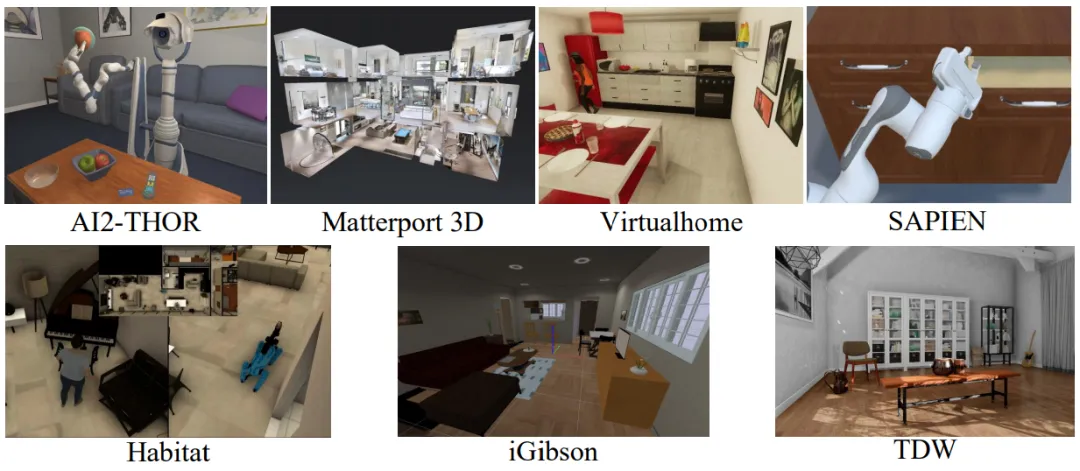

具身智能仿真平臺對于具身智能至關重要,因為它們提供了成本效益高的實驗手段,能夠通過模擬潛在的危險場景來確保安全,具有在多樣環境中進行測試的可擴展性,具備快速原型設計能力,能夠為更廣泛的研究群體提供便利,提供用于精確研究的可控環境,生成用于訓練和評估的數據,并提供算法比較的標準化基準。為了使智能體能夠與環境互動,必須構建一個逼真的模擬環境。這需要考慮環境的物理特性、對象的屬性及其相互作用。如下圖所示,兩種仿真平臺進,基于底層仿真的通用平臺和基于真實場景的仿真平臺。

圖6 底層仿真的通用平臺[4]

圖7 基于真實場景的仿真平臺[4]

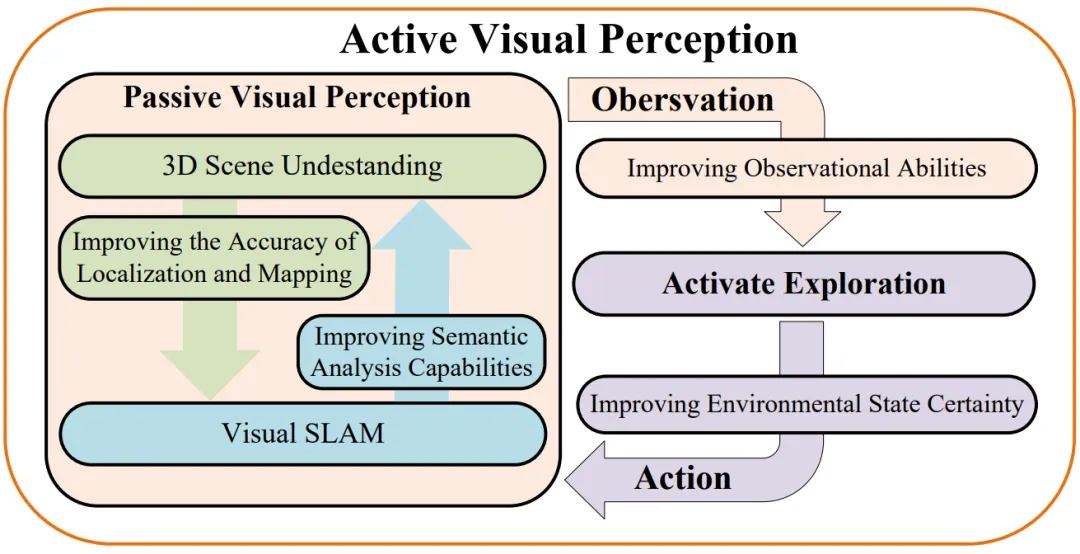

具身感知

以具身為中心的視覺推理和社會智能。如下圖所示,不同于僅僅識別圖像中的物體,具有具身感知能力的智能體必須在物理世界中移動并與環境互動,這需要對三維空間和動態環境有更透徹的理解。具身感知需要具備視覺感知和推理能力,理解場景中的三維關系,并基于視覺信息預測和執行復雜任務。可以主動視覺感知、3D 視覺定位、視覺語言導航、非視覺感知(觸覺傳感器)等實現。

圖8 理解場景三維關系[4]

主動視覺感知:主動視覺感知系統需要狀態估計、場景感知和環境探索等基本功能。這些功能已在視覺同步定位和地圖構建,可以感知系統,促進在復雜、動態的環境中改善環境交互和導航。

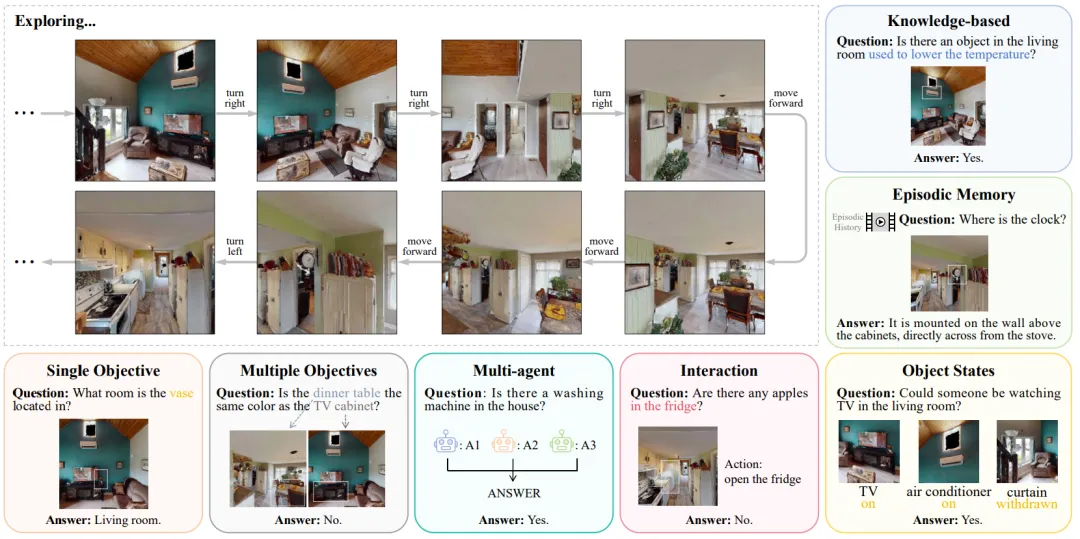

三維視覺定位:與在平面圖像范圍內運行的傳統 2D 視覺定位,3D視覺定位結合了對象之間的深度、透視和空間關系,為代理與其環境交互提供更強大的框架。視覺語言導航: 旨在使代理能夠按照語言指令在看不見的環境中導航。要求機器人理解復雜多樣的視覺觀察,同時以不同的粒度解釋指令。輸入通常由兩部分組成:視覺信息和自然語言指令。非視覺感知(觸覺):接觸式傳感器為試劑提供質地、硬度和溫度等詳細信息。對于相同的動作,從視覺和觸覺傳感器中學到的知識可能是相關和互補的,使機器人能夠完全掌握手中的高精度任務。具身交互具身交互指的是智能體在物理或模擬空間中與人類和環境互動的場景。典型的具身交互任務包括具身問答和具身抓取。如下圖所示,在具身問答任務中,智能體需要從第一人稱視角探索環境,以收集回答問題所需的信息。具有自主探索和決策能力的智能體不僅要考慮采取哪些行動來探索環境,還需決定何時停止探索以回答問題,如下圖所示。

圖9 具身問答框架[4]

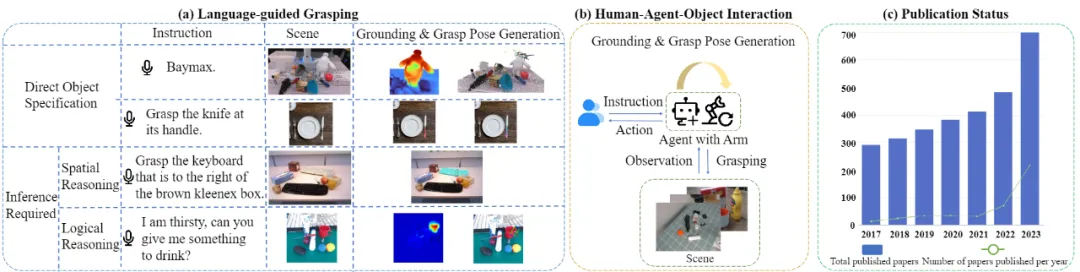

除了與人類進行問答交互外,具身交互還涉及基于人類指令執行操作,例如抓取和放置物體,從而完成智能體、人類和物體之間的交互。如圖所示,具身抓取需要全面的語義理解、場景感知、決策和穩健的控制規劃。具身抓取方法將傳統的機器人運動學抓取與大型模型(如大語言模型和視覺語言基礎模型)相結合,使智能體能夠在多感官感知下執行抓取任務,包括視覺主動感知、語言理解和推理。

圖10 語言引導的交互式抓取框架[4]

具身智能體

智能體被定義為能夠感知環境并采取行動以實現特定目標的自主實體。多模態大模型的最新進展進一步擴大了智能體在實際場景中的應用。當這些基于多模態大模型的智能體被具身化為物理實體時,它們能夠有效地將其能力從虛擬空間轉移到物理世界,從而成為具身智能體。為了使具身智能體在信息豐富且復雜的現實世界中運行,它們已經被開發出強大的多模態感知、交互和規劃能力。如下圖所示,為了完成任務,具身智能體通常涉及以下過程:將抽象而復雜的任務分解為具體的子任務,即高層次的具身任務規劃;通過有效利用具身感知和具身交互模型,或利用基礎模型的策略功能,逐步實施這些子任務,這被稱為低層次的具身行動規劃。值得注意的是,任務規劃涉及在行動前進行思考,因此通常在數字空間中考慮。相比之下,行動規劃必須考慮與環境的有效互動,并將這些信息反饋給任務規劃器以調整任務規劃。因此,對于具身智能體來說,將其能力從數字空間對齊并推廣到物理世界至關重要。

圖11 基于多模態大模型的具身智能體框架[4]

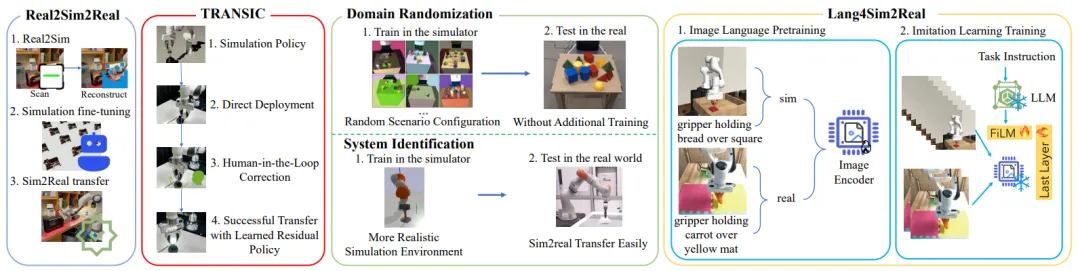

虛擬到現實的遷移

具身智能中的虛擬到現實的遷移指的是將模擬環境(數字空間)中學習到的能力或行為轉移到現實世界(物理世界)中的過程。該過程包括驗證和改進在仿真中開發的算法、模型和控制策略的有效性,以確保它們在物理環境中表現得穩定可靠。為了實現仿真到現實的適應,具身世界模型、數據收集與訓練方法以及具身控制算法是三個關鍵要素,下圖展示了五種不同的范式。

圖12 虛擬到現實的遷移方案[4]

總之,具身智能使智能體能夠感知、認知并與數字空間和物理世界中的各種物體互動,顯示了其在實現通用人工智能方面的重要意義。

【參考資料】

[1] 莫里斯·梅洛-龐蒂. 知覺現象學. 姜志輝, 譯. 北京: 商務印書館, 2001[2] 中國計算機學會,《具身智能》,2023[3] Merleau-Ponty, M. (1945). Phénoménologie de la perception. Gallimard.Pfeifer, R., & Bongard, J. (2006). [4] Liu, Yang, et al. “Aligning Cyber Space with Physical World: A Comprehensive Survey on Embodied AI.” arXiv preprint arXiv:2407.06886, 2024.[5]《科技熱詞“具身智能”到底是什么?》,中科院物理所[6]《具身智能時代來了?》,中國報道[7] Brooks, R. A. (1991). Intelligence Without Representation. Artificial Intelligence, 47(1-3), 139–159.

[8] Lakoff, G., & Johnson, M. (1999). Philosophy in the Flesh: The Embodied Mind and Its Challenge to Western Thought. Basic Books.

[9] Pfeifer, R., & Bongard, J. (2006). How the Body Shapes the Way We Think. MIT Press.

[10] How the Body Shapes the Way We Think: A New View of Intelligence. MIT Press.Shapiro, L. (2010). Embodied Cognition. Routledge.

[11] Varela, F. J., Thompson, E., & Rosch, E. (1991). The Embodied Mind: Cognitive Science and Human Experience. MIT Press.

[12]《2024年具身智能產業發展研究報告》,36氪研究院

[13]《具身智能發展報告(2024年)》,中國信息通信研究院

[14]《具身智能行業發展研究報告 系列報告之一:具身智能技術發展與行業應用簡析》,甲子光年智庫

[15]《中國具身智能創投報告》,量子位智庫

[16] L. Londono, J. V. Hurtado, N. Hertz, P. Kellmeyer, S. Voeneky, and A. Valada, “Fairness and bias in robot learning,” Proceedings of the IEEE, 2024.

[17] J. Duan, S. Yu, H. L. Tan, H. Zhu, and C. Tan, “A survey of embodied ai: From simulators to research tasks,” IEEE Transactions on Emerging Topics in Computational Intelligence, vol. 6, no. 2, pp. 230–244, 2022.

[18] Z. Xu, K. Wu, J. Wen, J. Li, N. Liu, Z. Che, and J. Tang, “A survey on robotics with foundation models: toward embodied ai,” arXiv preprint arXiv:2402.02385, 2024.

作者:畢蕾 中國移動咪咕公司北京研究院 系統開發總監

審核:

單華琦 中國移動咪咕公司北京研究院 技術標準總監

邢剛 中國移動咪咕公司北京研究院 技術項目總監

徐嵩 中國移動咪咕公司北京研究院 資深系統架構與分析專家

李琳 中國移動集團級首席專家 咪咕公司技術管理部總經理兼北京研究院院長,教授級高工

出品:科普中國×中國移動科學技術協會

來源: 科普中國

內容資源由項目單位提供

科普中國公眾號

科普中國公眾號

科普中國微博

科普中國微博

幫助

幫助

科普中國

科普中國