東坡肉、蘑菇炒青菜、清蒸鯽魚、蝦仁豆腐……做了滿滿一桌菜,拍張照片扔給AI,問它:圖片里的哪種食物蛋白質含量最高?哪道菜尿酸偏高的人不宜多吃?

AI深度思考了幾秒鐘,打出推理全過程,最后在圖片上將答案圈了出來。

這是學會推理的多模態大模型,未來在日常生活中的一個應用小場景。此前,這種“長眼睛”、擅長推理的AI還停留在想象階段。不過最近,來自杭州Om AI Lab的一群95后,已經成功地將DeepSeek-R1的訓練方法,從純文本領域遷移到視覺語言領域,打開了多模態大模型的更多想象空間。

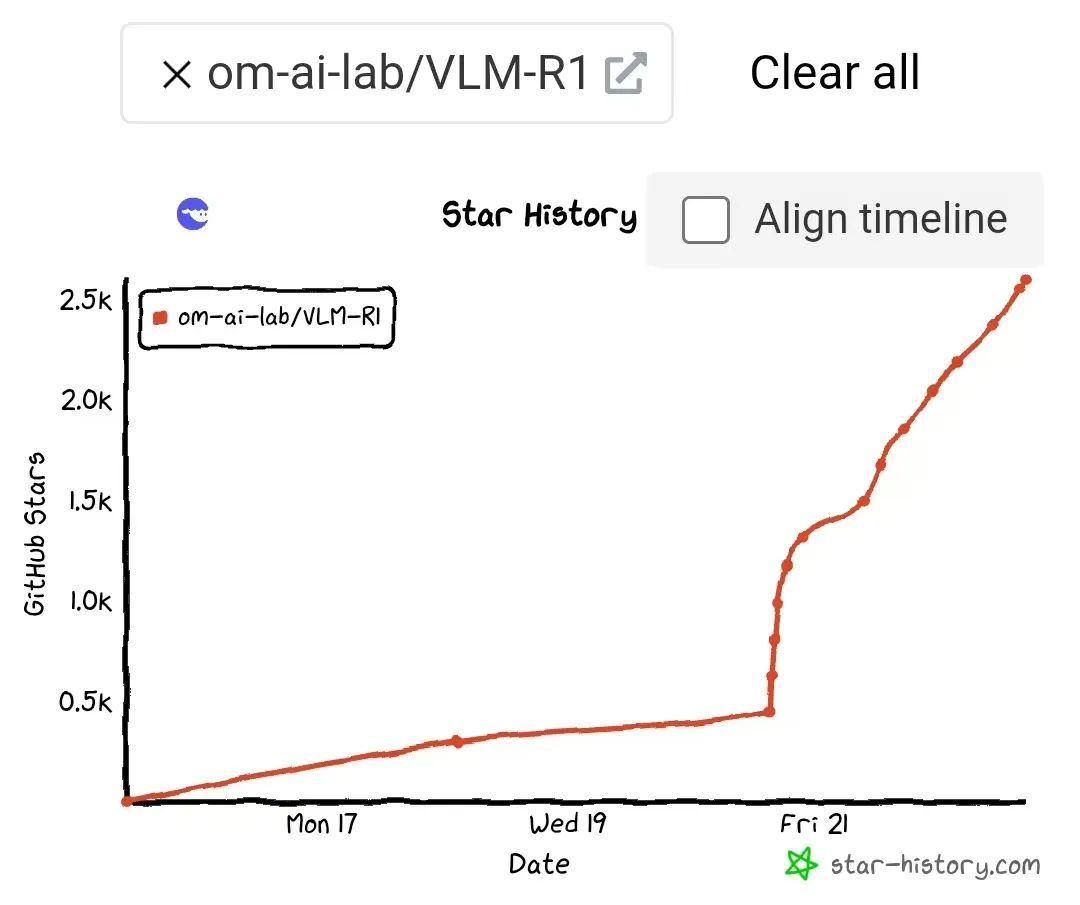

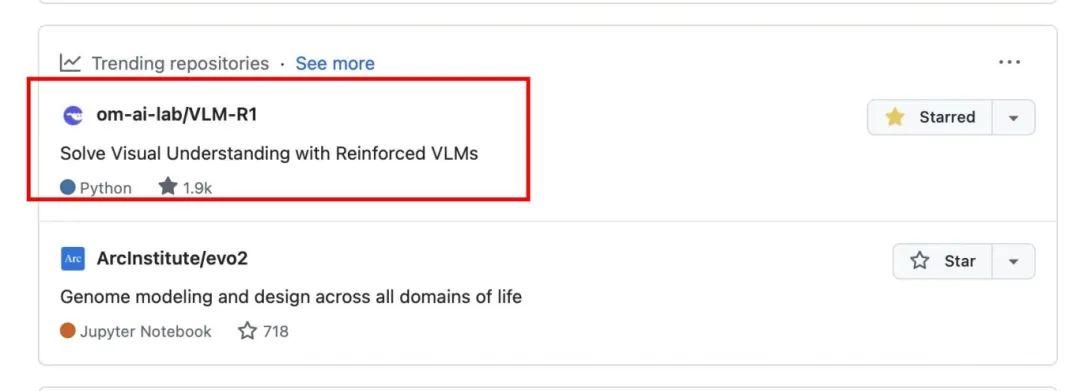

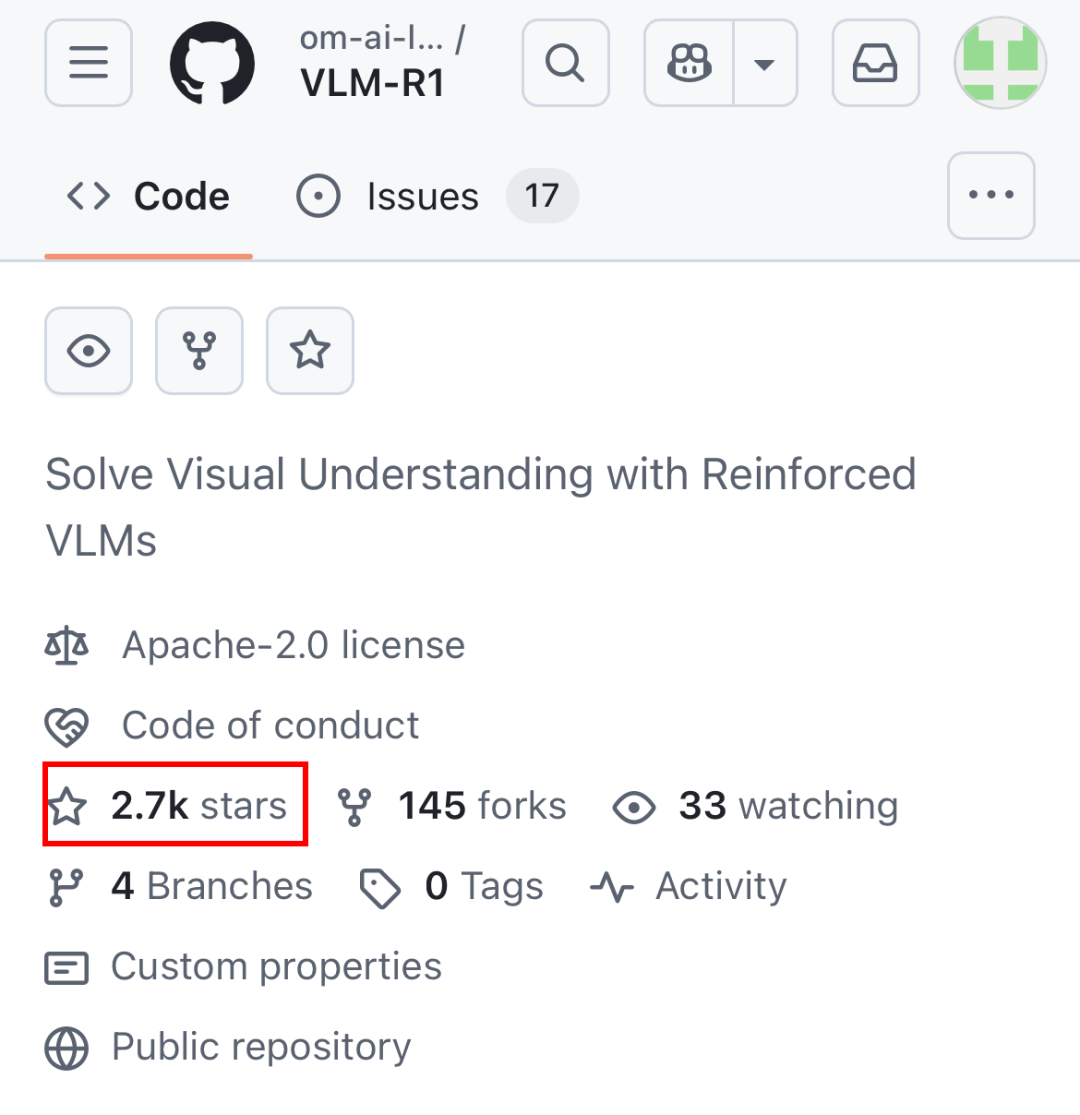

他們還將這個名叫VLM-R1的項目開源,發布在全球最大的代碼托管平臺GitHub上,上線僅一周,就獲得各國開發者給出的2.7k Stars(星標),并在2月21日登上熱門趨勢榜。這一成績在這個開源社區里堪稱亮眼。

VLM-R1上線GitHub一周的Star(星標)數據曲線

VLM-R1上線GitHub一周的Star(星標)數據曲線

2月21日上了GitHub熱門趨勢榜

這支研發團隊的帶頭人,是名90后——Om AI Lab的創始人趙天成博士,他同時也是浙江大學濱江研究院Om人工智能中心主任、博士生導師。

將教DeepSeek-R1推理的方法

帶到機器視覺領域

DeepSeek-R1模型的獨特之處,在于DeepSeek對通用的模型推理步驟進行了調整。此前,模型在提升推理能力時,通常依賴“監督微調”(即SFT,監督式微調)這個環節。簡單來說,就是拿一個已經學了不少東西的大模型,用一些特定的、標記好的數據,來教它如何更好地完成某個任務。這就好比你已會做菜,但具體到川菜或徽菜,還需通過專門的練習來掌握烹飪技巧。

而DeepSeek-R1在訓練過程中直接跳過了這個環節,進入“強化學習”階段,探索大模型在沒有監督數據的情況下,通過純強化學習進行自我進化。這種創新性的強化學習方法,有個專業名詞,叫群組相對策略優化(Group Relative Policy Optimization,GRPO)。

GRPO已經幫助DeepSeek-R1學習推理,那是否也能幫助AI模型在一般計算機視覺任務中表現得更強?

Om AI Lab研發團隊反復實驗后的答案是:可以。

他們在一個視覺定位任務中,訓練了通義開源視覺理解模型Qwen2.5-VL。在此基礎上,同時用R1方法和SFT方法進行對比。目前得出的結論是:R1方法在各種復雜場景下,都能保持穩定的高性能。這在實際應用時至關重要。

如下圖的街景照片,給AI的任務是:定位出圖中可能對視障人士行走造成危險的物體。

在路邊人行道的場景里,人類能想到對視障人士造成行走障礙的,通常是石墩子、公交站牌、行人等,這些就是可以提前標記好的“數據”。但在這張圖中,出現了一個比較特殊的情況——臺階。

從趙天成團隊的實驗看,經過R1方法訓練的AI模型,能夠成功推理出臺階在這個場景中會對視障人士造成危險。

“對人類來說,這屬于常識性推理,再容易不過。但對于此前傳統的計算機視覺模型而言,這其實非常難。”趙天成解釋。

又如下面這張圖,桌子上放著山藥、雞蛋餅、毛豆、青菜、咖啡和橙子,讓AI定位圖中含維生素C最多的食物。

使用R1方法訓練的AI模型,很快鎖定了橙子并附上思考過程。“以前它直給答案,不會告訴你解題思路,且錯誤率偏高,比如10道題最多答對四五題,而用R1方法訓練的,能答對七八題。”

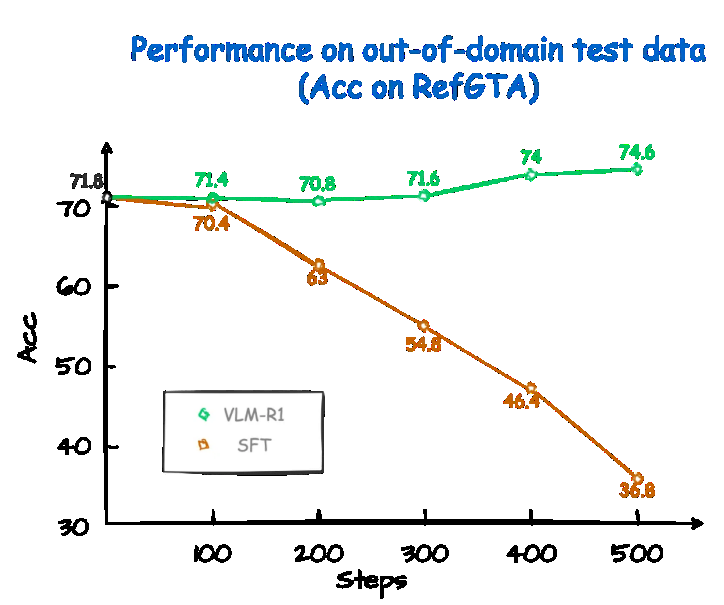

此外,機器學習領域有一種很常見的情況:用任務A去訓練模型,隨著訓練步數(訓練模型所執行的迭代次數)的增加,在跟A沒有那么相似的任務B上,它的性能會變差(圖中紅色曲線)。“有點‘摁了葫蘆起了瓢’的意思。所以以前做多任務時,還要精心控制任務間的比例。”而使用R1方法訓練的AI模型(圖中綠色曲線)并不會出現這種趨勢,這意味著R1方法能幫助模型真正“學會”理解視覺內容,而不是簡單地記憶。

綠色曲線是使用R1方法訓練,紅色曲線是使用傳統的SFT方法。

綠色曲線是使用R1方法訓練,紅色曲線是使用傳統的SFT方法。

為視覺語言模型訓練

打了新思路

“實驗從春節長假期間開始啟動。好在前期積累比較多,很多‘基礎設施’是現成的,有了想法后,能快速進行實驗、驗證結果。”組成團隊的10人,有研究院的研發人員,也有趙天成帶的博士生。

2月15日,趙天成在海外社交平臺上發布VLM-R1的實驗結果,并將它開源、上傳到GitHub,截至2月22日,已獲得全球開發者們給出的2.7k Stars。

大大小小的交流切磋問題蜂擁而來:要訓練多久,最低顯存是多少,能否再多分享幾個模型思考過程……

“雖然底層邏輯是相通的,但視覺和數學、代碼是完全不同的模態。怎么在視覺領域進行設計,讓它真正跑通,團隊其實也經歷了多次試錯,才找到目前這樣一個比較有效的組合。”趙天成坦言,現在這個版本只能算是0.1版,遠未達到成熟,“有一些問題,需要繼續用更多實驗來解答。”

在他看來,這段時間的實驗,最大意義之一是為多模態模型的訓練和行業提供了一些新的思路。它證明了R1方法的通用性,“不僅在文本領域表現出色,還可能引領一種全新的視覺語言模型訓練潮流。”

“做一個勇于嘗試的引領者

比在風口追隨著他人來得重要”

Om AI Lab背后的母公司聯匯科技,位于杭州濱江互聯網產業園,這里曾是阿里、網易崛起的搖籃,互聯網和物聯網技術從這里走入我們的日常生活。眼下,人工智能成了主角,這家公司正在致力于人工智能智能體平臺的應用和落地。

2月21日,由趙天成帶隊的Om AI Lab,在上海舉行的2025全球開發者先鋒大會(GDC)上,帶去了基于R1強化學習的視覺理解多模態模型VLM-R1的首秀,以及開源大語言模型智能體評測平臺Open Agent Leaderboard。

趙天成 (陳中秋 攝)

去年8月,趙天成在接受采訪時說,他始終記得當年在美國卡耐基梅隆大學(CMU)求學時導師說的一句話:To be a leader, not a follower,做一個勇于嘗試的引領者,遠比在風口追隨著他人來得重要。

(來源:潮新聞)

來源: 浙江省科學技術協會

科普中國公眾號

科普中國公眾號

科普中國微博

科普中國微博

幫助

幫助

浙江省科學技術協會

浙江省科學技術協會